Depuis quelques semaines, un nouveau type de vidéo envahit les réseaux sociaux : deux clips côte à côte, même scène, mêmes éclairages, mais deux personnages différents. Derrière ce phénomène, une technologie d’IA baptisée vidéo mimétique, propulsée par le modèle open source Wan 2.2 d’Alibaba. Décryptage.

C’est quoi, une vidéo IA mimétique ?

Le principe est aussi simple que bluffant : vous prenez une vidéo source (un discours, une danse, une interview,…) et vous y incrustez un autre personnage qui reproduit exactement les mêmes mouvements, la même posture, les mêmes expressions. Le résultat ? Une vidéo dans laquelle n’importe qui peut se glisser dans la peau de n’importe qui d’autre, avec une fidélité déconcertante.

Dans cette vidéo qui est le pilier de cet article, je vous montre plusieurs exemples de vidéos mimétiques :

Ce n’est pas de la deepfake classique. Il ne s’agit pas de coller un visage sur un corps. C’est un transfert de mouvement complet : chaque micro-geste, chaque inclinaison de tête, chaque expression sont reproduits avec une précision au centième de seconde près. Le tout grâce au modèle Wan 2.2, développé par les labos d’Alibaba Cloud.

Au programme de cet article :

Wan 2.2 : le modèle derrière la magie

Wan 2.2 est un modèle de génération de vidéo open source signé Alibaba Labs. Si Alibaba est surtout connu comme le géant chinois de l’e-commerce, sa branche cloud joue dans la même cour qu’Amazon Web Services : hébergement, infrastructure, et désormais modèles d’IA mis à disposition du monde entier.

Ce qui distingue Wan 2.2 des modèles classiques, c’est son architecture technique, qui repose sur deux piliers :

Le Mixture of Experts (MoE)

Popularisée par des modèles comme Mistral (la pépite française de l’IA), cette architecture consiste à diviser le traitement entre plusieurs « experts » spécialisés. Chaque expert gère ce qu’il sait faire de mieux, puis leurs résultats sont combinés. Résultat : moins d’aberrations, et une précision bien supérieure sur des tâches complexes comme le transfert de mouvement.

Le LoRA (Low Rank Adaptation)

Le LoRA est une technique de fine-tuning qui affine un modèle sur un aspect très précis, sans tout réentraîner. En génération d’images, un LoRA peut se spécialiser sur la texture de la peau. Dans Wan 2.2, il permet de conserver avec une haute fidélité les mouvements de la vidéo source : chaque geste des doigts, chaque mouvement de tête, dans le personnage de destination.

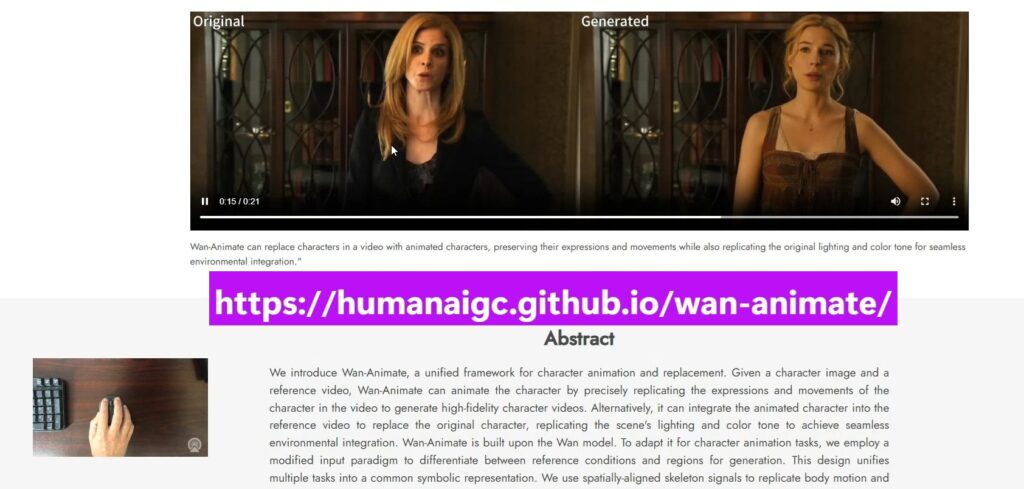

En pratique : les vidéos IA mimétiques du GitHub d’Alibaba

Le code source de Wan est disponible en open source sur le GitHub officiel d’Alibaba, qui comptabilise déjà plus de 25 000 étoiles, preuve de l’engouement de la communauté tech mondiale.

Les démonstrations sont éloquentes : un chien qui court dont les mouvements sont transférés sur un robot. Un chercheur qui parle, et dont les gestes sont reproduits par… Shrek. Le résultat est déconcertant de réalisme, au point qu’on ne distingue plus les mouvements originaux de la copie.

Wan + Higgsfield génèrent la vidéo de droite (generated) !

Pour les plus curieux, le papier technique (l’abstract sur GitHub) détaille précisément comment le modèle atteint cette haute fidélité via la combinaison LoRA + Mixture of Experts. C’est le cœur de la machine.

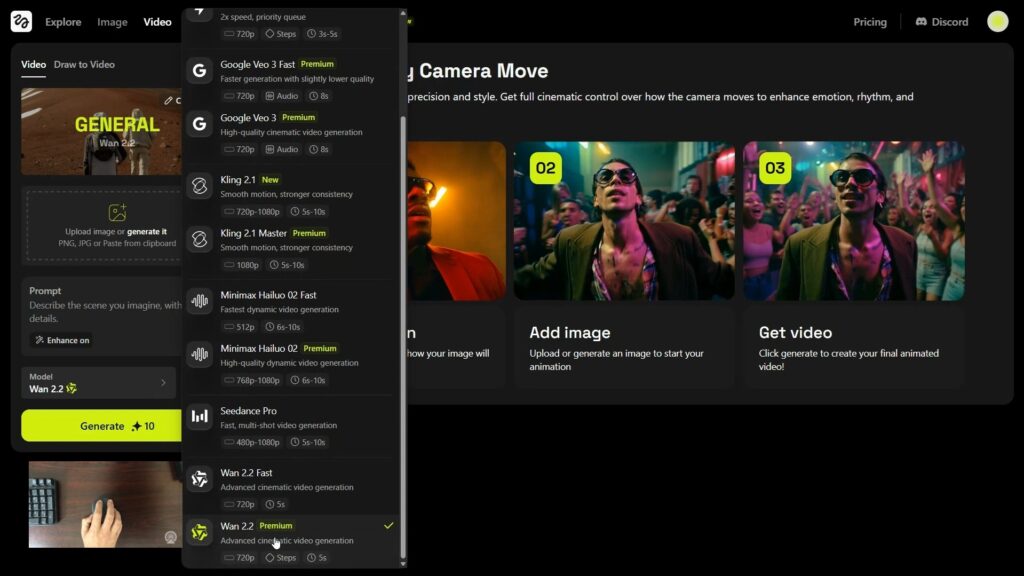

Comment générer vos vidéos IA : Higgsfield en trois clics

Pas besoin d’être développeur. L’outil le plus accessible pour tester les vidéos mimétiques, c’est Higgsfield. La manipulation est directe :

1. Importez votre vidéo de référence (celle dont vous voulez copier les mouvements).

2. Uploadez une image du personnage à incruster : une simple photo suffit.

3. Lancez la génération. En quelques secondes, Wan 2.2 fait le reste.

La fonctionnalité mimétique (« Mimic ») nécessite un abonnement premium. En gratuit, vous pouvez néanmoins prendre en main la plateforme et tester d’autres modèles — Higgsfield intègre aussi Google Veo, Kling, Minimax, Seedance et d’autres modèles phares du moment.

Pour les utilisateurs qui veulent aller plus loin, un espace Hugging Face propose également un accès gratuit au Fun Control Wan 2.2, et le code source complet est disponible sur GitHub pour ceux qui souhaitent l’héberger sur leur propre infrastructure.

Ce que ça change (et ce que ça soulève)

Pour les créateurs de contenu, les possibilités sont évidentes : se mettre en scène dans n’importe quelle situation, transposer des discours célèbres dans son propre univers créatif, générer des formats vidéo à moindre coût. L’IA mimétique n’est plus un gadget de laboratoire — c’est un outil de production accessible en quelques clics.

Mais la technologie soulève aussi des questions légitimes sur le consentement et l’usage des images. À mesure que ces outils deviennent accessibles au grand public, la distinction entre ce qui est réel et ce qui est généré devient de plus en plus difficile à établir.

En résumé pour une vidéo IA « Clone » au top

Les vidéos IA mimétiques, c’est le transfert de mouvement poussé à son paroxysme. Wan 2.2 (Alibaba) combine Mixture of Experts et LoRA pour reproduire les gestes d’un personnage sur un autre, avec une fidélité déconcertante. Higgsfield rend cette technologie accessible sans une ligne de code. Et la communauté open source peut aller encore plus loin via GitHub et Hugging Face.

Vous voulez devenir le personnage principal 😎 de votre film préféré 🎬 ?

C’est par ici :

👉 Créer votre Vidéo IA Mimétique maintenant avec Wan dans Higgsfield